- 1. Інструкції по індексації

- 2. Метатеги Title і Description

- 3. XML-карта сайту

- 4. Час відповіді сервера

- 5. Дублікати

- 6. Контент

- 7. Биті посилання

- 8. Редіректи

- 9. Атрибут rel = canonical

- 10. Змішаний контент

- Коротко про головне

Привіт, шановні читачі блогу KtoNaNovenkogo.ru. Перебуваючи на початковому етапі пізнання пошукової оптимізації, багато маркетологів і майбутні SEO-фахівці стикаються зі шквалом різнорідної інформації, яку спочатку важко упорядкувати і структурувати.

Яким аспектам SEO варто приділити увагу в першу чергу? З чого почати оптимізацію сайту? Як провести первинний технічний аудит і обробити отриману інформацію? Відповіді на ці та багато інших питань ви знайдете в даній статті.

1. Інструкції по індексації

Налаштування інструкцій для пошукових роботів - чи не перше, з чим доводиться розбиратися кожному початківцю фахівця, і однозначно найперше, в чому допускається основна маса фатальних помилок, що перешкоджають пошуковому просуванню сайту.

У числі найбільш поширених промахів можна назвати наступні:

- від індексації закриті сторінки, які повинні бути проіндексовані і потенційно можуть приносити трафік;

- від індексації закриті файли, що впливають на зовнішній вигляд сторінки;

- від індексації закриті сторінки, на які виставлено перманентний редирект, або які вказані в якості канонічних;

- виставлений атрибут rel = nofollow для посилань на внутрішні сторінки, за рахунок чого втрачається частина посилального ваги.

Визначити, які інструкції виставлені на сторінках всередині вашого сайту, і чи немає якихось проблем, пов'язаних з неправильним зазначенням директив robots.txt, Meta Robots або X-Robots-Tag, можна за допомогою краулер. Ми будемо використовувати в якості інструменту для проведення SEO-аудиту Netpeak Spider .

Отже, для аналізу пошукових директив потрібно зробити наступне:

- Запустіть Netpeak Spider.

- Відкрийте в основному меню «Налаштування» → «Основні».

- Встановіть налаштування за замовчуванням.

- Щоб переконатися, що файли .js і .css не закриті від індексації, включите перевірку JavaScript і CSS.

- Збережіть налаштування і поверніться до основного вікна програми.

- Перейдіть до бічної панелі і відкрийте вкладку «Параметри».

- Переконайтеся, що всі параметри в пункті «Індексація» включені.

- Введіть адресу сайту в рядок «Початковий URL» і запустіть сканування.

За підсумком сканування ви зможете отримати детальну інформацію декількома шляхами:

- Таблиця з інформацією по всіх просканувати URL.

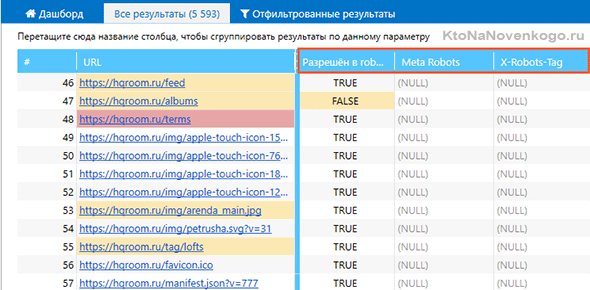

За підсумком сканування перед вами постане таблиця з повним списком просканованих сторінок. У стовпці «Дозволено в robots.txt» ви побачите, чи не закритий кожен окремий URL від індексації, а в стовпчиках «Meta Robots» і «X-Robots-Tag» будуть вказані застосовані до даного URL директиви.

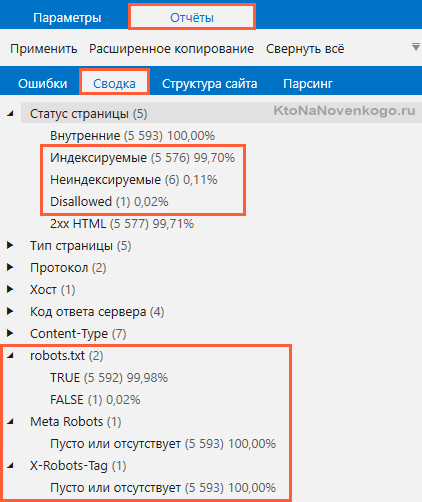

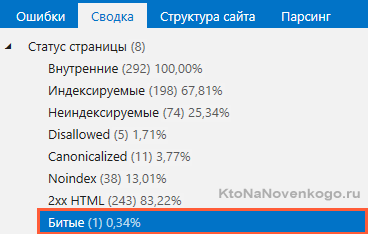

- Вкладка «Зведення» ( «Звіти») на бічній панелі.

Вибравши вас ознака, яким відповідають ті чи інші сторінки, ви отфильтруете результати сканування, зосередившись виключно на тих URL, для яких в robots.txt прописаний Disallow, або, наприклад, на яких виставлено nofollow, noindex за допомогою Meta Robots або X- Robots-Tag.

- Вкладка «Помилки (« Звіти ») на бічній панелі.

На підставі результатів сканування програма визначає кілька десятків типів помилок, в тому числі - помилки (попередження), пов'язані з інструкціями для індексації. - Дашборда з даними про статус індексованих.

На вкладці «дашборда» по сусідству з таблицею результатів сканування інформація про індексованих і Неіндексований сторінках сайту буде представлена у вигляді кругової діаграми. Там же можна буде знайти діаграму, що наочно демонструє причини Неіндексований. Кожен із сегментів діаграми клікабелен і діє за аналогією з фільтрацією, яка була описана вище.

2. Метатеги Title і Description

Оптимізація метатегов Title і Description - один з найважливіших етапів пошукової оптимізації сайту. По-перше, їх вміст ретельно аналізується пошуковими роботами для складання загального уявлення про вміст сторінки. По-друге, саме вони формують сниппет сторінки в пошуковій видачі.

У розрізі SEO-аудиту сайту необхідно проаналізувати:

- на всіх чи сторінках є Title і Description;

- зі скількох символів складаються Title (не менше 10 і не більше 70 символів в середньому) і Description (не менше 50 і не більше 260-320 символів);

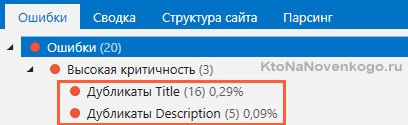

- чи немає дублів, Title і Description всередині сайту;

- не присутній чи на сторінці відразу кілька Title і Description.

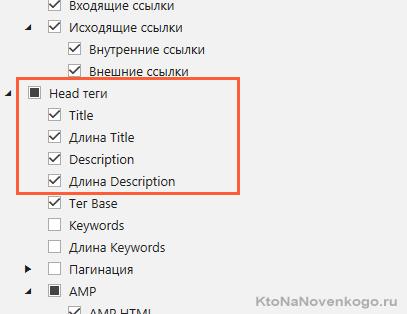

Щоб з'ясувати, яка ситуація з даними метатегами в рамках вашого сайту, обов'язково відзначте на бічній панелі параметри «Title», «довжина Title», «Description» і «довжина Description».

До слова, якщо вам потрібно, щоб Title і Description були строго певної довжини, ви можете задати діапазон допустимих значень в розділі «Налаштування» → «Обмеження».

У процесі сканування програма визначить довжину кожного з метатегов, а на вкладці з помилками вкаже всі наявні проблеми Title і Description.

3. XML-карта сайту

Перш ніж приступити до перевірки карти сайту, дайте собі відповідь на два питання:

- Чи є на аналізованому сайті XML-карта сайту?

- Якщо так, то чи зазначений її адресу у файлі robots.txt?

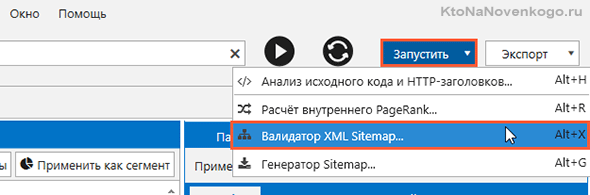

Якщо відповідь на обидва питання "так", фахівця, який здійснює аудит, залишається тільки одне: проаналізувати карту на наявність різного роду помилок. Найкраще робити це за допомогою вбудованого в Netpeak Spider інструменту «Валідатор XML Sitemap». Для запуску перевірки вам потрібно:

- Запустити Netpeak Spider.

- У правому верхньому кутку натиснути «Запустити» → «Валідатор XML Sitemap».

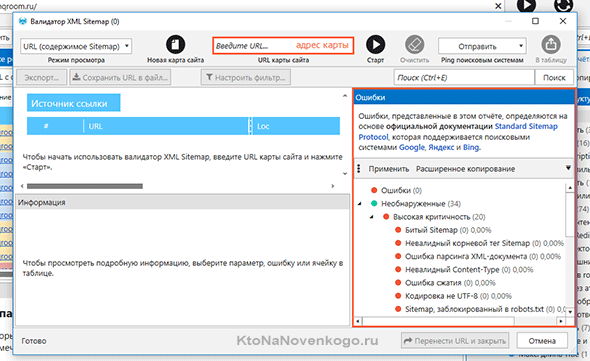

- Ввести адресу карти і натиснути «Старт» для запуску.

* При кліці по картинці вона відкриється в повний розмір в новому вікні - Дочекатися закінчення сканування і ознайомитися зі списком знайдених помилок на бічній панелі. Всі включені в карту сайту сторінки, на яких були знайдені помилки, можна перенести в основну таблицю, натиснувши кнопку «Перенести URL і закрити».

4. Час відповіді сервера

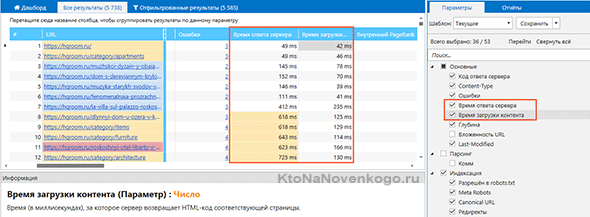

Чим швидше ваш сайт працює, тим краще. Це стосується швидкості відповіді сервера, який повинен максимально швидко відгукнутися на запит, відправлений браузером, а також швидкості завантаження самого контенту.

Для аналізу обох показників ми скористаємося краулер. Процедура сканування проводиться за аналогією з тією, що ми описували вище: головне - не забути відзначити параметри «Час відповіді сервера» і «Час завантаження контенту» перед стартом аналізу.

* При кліці по картинці вона відкриється в повний розмір в новому вікні

По закінченню сканування занадто повільні сторінки будуть відзначені як сторінки з помилкою середньої критичності «Великий час відповіді сервера».

5. Дублікати

При повному або частковому дублювання контенту усередині сайту, нехай навіть ненавмисно, може істотно ускладнити шлях вашого сайту до вершин органічної пошукової видачі. Пошукові системи вкрай негативно реагують на дублі, так що в рамках SEO-аудиту вам слід звернути увагу на всі основні види дублів всередині свого сайту для їх подальшого усунення.

Скануючи сайт в Netpeak Spider, ви зможете виявити повні дублікати сторінки, а також дублікати метатегов Title і Description (ми вже говорили про них в параграфі 2), заголовків H1 і текстового вмісту.

6. Контент

Грамотно оптимізоване вміст сторінки має включати в себе:

- грамотний і унікальний текст обсягом не менше 500 символів;

- один основний заголовок першого порядку H1;

- оптимізовані зображення з прописаним атрибутом ALT.

Якщо у вас є чітке розуміння того, в яких рамках може варіюватися вага зображень, розмір H1 і обсяг тексту, їх можна задати вручну в розділі «Налаштування» → «Обмеження».

Щоб перевірити кожен із зазначених вище аспектів, слід:

- Запустити Netpeak Spider.

- У списку параметрів на бічній панелі обов'язково зазначити:

- «Контент» → «Зображення»;

- «Заголовки H1-H6» → «Вміст H1», «Довжина H1», «заголовки H1»;

- «Показники» → «Розмір контенту».

Якщо ви хочете додатково перевірити сайт (розділ сайту, список сторінок) на предмет наявності підзаголовків H2 і H3, відзначте відповідні параметри в пункті «Заголовки H1-H6».

- Ввести адресу сайту і запустити сканування.

- Після завершення процедури в основній таблиці з результатами сканування ви побачите стовпчики з даними за обсягом контенту, а також - по довжині H1. На бічній панелі на вкладці «Звіти» → «Помилки» висвітяться помилки, пов'язані з оптимізацією контенту, включаючи проблеми з заголовками H1, розміром контенту і відсутністю атрибута ALT у зображень.

Списки URL, що містять одну (або більше) з помилок вище, можна відфільтрувати і вивантажити в вигляді окремого звіту.

7. Биті посилання

Існує безліч неоднозначних чинників пошукової оптимізації, щодо яких в експертному середовищі немає однозначної думки. Однак биті посилання (посилання, що віддають 404 код відповіді сервера) точно не відносяться до їх числа: всі досвідчені фахівці в один голос твердять про їх вкрай згубний на оптимізацію сайту.

Пошук битих посилань - процедура, яку вам належить виконувати на регулярній основі, а не тільки в рамках глобального первинного SEO-аудиту.

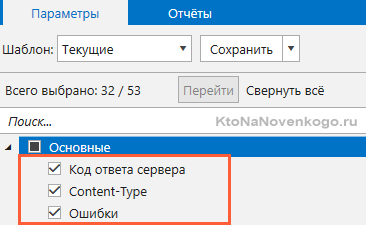

Для аналізу сайту на предмет пошуку битих посилань досить буде активувати всього три параметри: «Код відповіді сервера», «Content-Type», «Помилки».

За підсумком сканування ви зможете знайти всі сторінки, що віддають 404 помилку, в основній таблиці з результатами сканування (навпроти них буде вказано відповідний код відповіді сервера), на панелі «Зведення», а також в списку сторінок, відфільтрованих по помилках «Биті посилання» і «Биті зображення».

8. Редіректи

Установки перенаправлень, або редиректів, - обов'язковий етап оптимізації будь-якого сайту. Редіректи допомагають боротися з дублікатами і направляти користувачів на потрібні сторінки в разі переходу на вже неіснуючі URL.

Важливо пам'ятати про те, що виставлений на постійній основі редирект повинен віддавати виключно 301 (НЕ 302) код відповіді, а також не повинен вести на сторінку з подальшою переадресацією. Також не забувайте, що для успішної індексації цільової сторінки пошуковими роботами вона не повинна бути закрита за допомогою robots.txt, Meta Robots або X-Robots-Tag.

Таким чином, в числі основних проблем, пов'язаних з переадресацією, можна назвати наступні:

- Битий редирект (перенаправлення на недоступну або неіснуючі сторінки).

- Нескінченний редирект (перенаправлення з поточної сторінки на саму себе).

- Максимальна кількість редиректів (більше 4 редиректів в послідовності за замовчуванням).

- Редирект, заблокований в robots.txt.

- Редіректи з неправильним форматом URL (перенаправлення з неправильним форматом URL в HTTP-заголовках відповіді сервера).

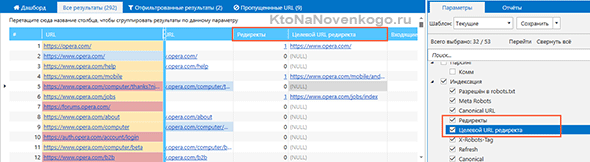

В процесі проведення технічного аудиту ви зможете виявити на вашому сайті всі вищезгадані проблеми, а також проконтролювати коректність вказівки кінцевих URL для переадресації.

* При кліці по картинці вона відкриється в повний розмір в новому вікні

9. Атрибут rel = canonical

Не виключено, що на підході до дев'ятого пункту вам на мить могло здатися, що все найважливіше вже залишилося позаду. Однак до тих пір, поки в чекліст SEO-аудиту не включений аналіз атрибута Canonical, його не можна вважати повноцінним. Які ж проблеми можуть бути пов'язані з неправильно вибрано параметр Canonical?

- ланцюжок Canonical;

- Canonical, заблокований в robots.txt (іншими словами, пріоритетна для індексації сторінка віддає код відповіді, відмінний від 200 OK).

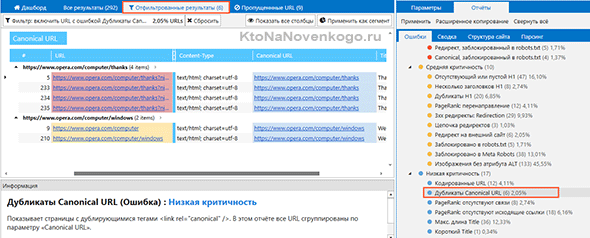

Також не варто забувати про ймовірність того, що якісь з атрибутів були виставлені помилково, а тому не дозволяють як слід індексуватися важливих сторінок вашого сайту. Щоб проконтролювати цей аспект оптимізації, ми рекомендуємо скористатися фільтрацією по таких помилок (попередженням низькою критичності) Netpeak Spider, як «Неканонічні сторінки» і «Дублікати Canonical URL».

Перша показує неканонічні сторінки, у яких URL в тезі

вказує на іншу сторінку, друга показує сторінки з дублюючими тегами (при використанні цього фільтра все URL будуть згруповані по параметру «Canonical URL»).

* При кліці по картинці вона відкриється в повний розмір в новому вікні

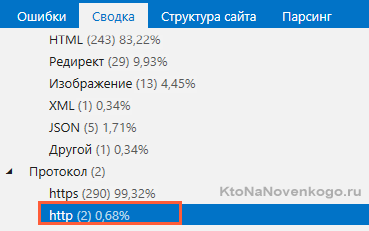

10. Змішаний контент

Якщо раніше ви зробили спробу «переїзду» на безпечний протокол HTTPS, але не налаштували сайт необхідним чином, ви зіткнетеся з таким поняттям як «змішаний контент». Воно означає, що на сайті одночасно є сторінки з безпечним і небезпечним протоколом. Щоб перевірити, чи стосується це і до вашого сайту, запустіть сканування з параметрами за замовчуванням.

Список сторінок, протокол яких не змінився після переїзду на HTTPS, можна буде знайти на бічній панелі на вкладці «Зведення».

Також вони будуть підсвічені як сторінки з помилкою (низька критичність) «Не HTTPS-протокол».

Коротко про головне

Щоб провести базовий технічний SEO-аудит сайту перед початком роботи над новим проектом, включіть в нього перевірку декількох основних пунктів:

- Перевірка інструкцій по індексації,

- Перевірка правильності заповнення Meta Title і Meta Description,

- Валідація XML-карти сайту,

- Аналіз часу відповіді сервера,

- Пошук дублікатів,

- Перевірка оптимізації контенту,

- Перевірка сайту на наявність битих посилань,

- Перевірка виставлених редиректів,

- Перевірка атрибута rel = canonical,

- Пошук змішаного контенту, який виник при спробі переїзду на HTTPS-протокол.

Для аналізу вам знадобиться краулер, в якості якого ми використовували Netpeak Spider . який визначить всі ключові проблеми сайту для їх подальшого усунення.

PS Для читачів блогу діє спеціальна знижка на покупку ліцензій Netpeak Spider - 10%. Щоб її використовувати, на етапі оплати введіть промокод 8018e2e0

Удачі вам! До швидких зустрічей на сторінках блогу KtoNaNovenkogo.ru

Збірки по темі

Використовую для заробітку

Яким аспектам SEO варто приділити увагу в першу чергу?З чого почати оптимізацію сайту?

Як провести первинний технічний аудит і обробити отриману інформацію?

Txt?

Які ж проблеми можуть бути пов'язані з неправильно вибрано параметр Canonical?