[ 0 ] [ 1 ] [ 2 ] [ 3 ] [ 4 ] [ 5 ] [ 6 ] [ 7 ] [ 8 ] [ 9 ] [ 10 ] [ 11 ] [ 12 ] [ 13 ] [ 14 ] [ 15 ] [ 16 ] [ 17 ] [ 18 ] [ 19 ] [ 20 ] [ 21 ] [ 22 ] [ 23 ] [ 24 ] [ 25 ] [ 26 ] [ 27 ] [ 28 ] [ 29 ] [ 30 ] [ 31 ] [ 32 ] [ 33 ] [ 34 ] [ 35 ] [ 36 ] [ 37 ] [ 38 ] [ 39 ] [ 40 ] [ 41 ] [ 42 ] [ 43 ] [ 44 ] [ 45 ] [ 46 ] [ 47 ] [ 48 ] [ 49 ] [ 50 ] [ 51 ] [ 52 ] [ 53 ] [ 54 ] [ 55 ] [ 56 ] [ 57 ] [ 58 ] [ 59 ] [ 60 ] [ 61 ] [ 62 ] [ 63 ] [ 64 ] [ 65 ] [ 66 ] [ 67 ] [ 68 ] [ 69 ] [ 70 ] [ 71 ] [ 72 ] [ 73 ] [ 74 ] [ 75 ] [ 76 ] [ 77 ] [ 78 ] [ 79 ] [ 80 ] [ 81 ] [ 82 ] [ 83 ]

zawsze będzie na liście prac; aktywność nierówności początkowych w tym przypadku zależy od tego, czy odpowiednie zmienne pomocnicze znikną.

Uwagi i wybrana bibliografia do sekcji 6.3

Idea „odlewania” lub „projektowania” gradientów była pierwotnie wyrażana w odniesieniu do problemów z ograniczeniami liniowymi. Odniesienia do odpowiednich prac podano w uwagach do rozdz. 5.1 i 5.2. W przypadku problemów z ograniczeniami nieliniowymi pierwszą metodę „rzutów gradientów” zaproponował Rosen (1961), który uogólnił podobną metodę minimalizacji zaprojektowaną przez niego z ograniczeniami liniowymi (Rosen, 1960). Aby określić w algorytmie Rosena, macierz ortogonalna Zj jest niejawnie używana.

Autorami uogólnionego schematu obniżonego gradientu są Abadi i Carpentier (1965, 1969). W pierwszej implementacji macierz (6.18) została skonstruowana w jawnej formie. Program, opracowany przez Abadie i jego kolegów z Electricite de France, był szeroko wykorzystywany do rozwiązywania praktycznych problemów (patrz na przykład Abadie i Gigoux (1970)). Eksperymentalne porównanie różnych metod przeprowadzonych przez Colville'a (1968) wykazało, że metody uogólnionych gradientów zredukowanych należą do najbardziej niezawodnych i skutecznych. Do tej pory ich rodzina została uzupełniona dużą liczbą nowych algorytmów: jak już wspomniano w sekcji. 6.3.1, w celu określenia każdego elementu schematu typu gradientów, istnieje wiele możliwości.

W ostatnich latach metodami iad, takimi jak podane gradienty, były między innymi Sargent i Murtaf (1973), Abadi (1978), Lesdon i Warren (1978),

Wiadomo, że przy zasadniczo nieliniowych ograniczeniach metody typu zredukowanych gradientów działają słabo, ponieważ trudno jest śledzić granice dopuszczalnego zbioru silnie zakrzywionego (patrz Rozdział 6.3.2). W związku z tym złożono różne propozycje, w szczególności zaproponowano niedoszacowanie wymaganej dokładności zgodności z ograniczeniami. To prawda, że ta ostatnia oznacza rewizję głównych pozycji i przejście do klasy metod zaprojektowanego Lagrangianu (patrz sekcja 6.5). Ogólny przegląd metod, takich jak zmniejszone gradienty, z pewnymi rozważaniami na temat ich związku z metodami zaprojektowanego Lagrangianu, zostanie znaleziony w artykule Sargenta (1974),

6.4. METODY ZMODYFIKOWANYCH FUNKCJI LAGRANGE

Do klasy metod zmodyfikowanych funkcji Lagrange'a można przejść na różne sposoby. Jednak cel końcowy jest zawsze formułowany w ten sam sposób: aby ograniczyć poszukiwania rozwiązania problemów z NEP lub NIP do

nieograniczony, z funkcją pomocniczą wybraną w taki sposób, że (i) nie ma nieuniknionej złej warunkowości (jak w metodach łagodnych kar i funkcji barierowych z sekcji 6.2.1) i (ii) Φ ma ciągłe pierwsze pochodne (w przeciwieństwie do niezagładzonych funkcji karnych). funkcje ns sekcja 6.2.2).

6.4.1. OZNACZANIE ZMODYFIKOWANEJ FUNKCJI LAGRANGE

Metody, które omówimy tutaj i w rozdz. 6.5, zostaną uzyskane z rozważanych wcześniej warunków optymalności (patrz Rozdział 3.4) i zasadniczo wykorzystują mnożniki Lagrange'a, a raczej ich szacunki. Po pierwsze, przedstawiamy główne idee, nie omawiając szczegółów wdrożenia. Szczegółowy opis metod szacowania czynników w problemach z nieliniowymi ograniczeniami zostanie podany w sek. 6.6.

Metody zmodyfikowanych funkcji Lagrange'a mogą być wykorzystywane zarówno w przypadku problemów z równością, jak iw przypadku problemów z nierównościami. Zasada rozliczania równości jest zawsze taka sama, a dla nierówności możliwe są opcje. Zwykle stosuje się pewną strategię przewidywania aktywnej rekrutacji, a następnie na początku każdego cyklu bezwarunkowej minimalizacji określa się jakąś zasadę, z którą będą się wiązać ograniczenia (patrz Rozdział 6.5.5). Inne wzory rozliczania nierówności w metodach zmodyfikowanych funkcji Lagrange'a są omówione w Dla uproszczenia załóżmy, że właściwa lista ograniczeń aktywnych w x * jest znana z góry, a przez c (x) oznaczamy wektor złożony z ich funkcji.

W dalszej części uważa się, że w wymaganym punkcie x * spełnione są wystarczające warunki optymalności sekcji nz. 3.4, w szczególności

g (x) = A {xfX.

(6.22)

Tutaj macierz A, której t wiersze są gradientami aktywnych więzów w X *. Jeśli L (x *) ma pełną rangę, wektor X "jest jednoznacznie określony przez równość (6.22). Wprowadzamy funkcję Lagrange'a

L {x, C = P (x) - 1s (x).

(6.23)

(Zauważ, że definicja (6.23) zależy od tego, jak powstaje wektor c.) Relacja (6.22) oznacza, że dla K = k * x * będzie to jej stacjonarny (w x) punkt. Jeśli ta stacjonarność oznaczała ekstremalność, funkcja Lagrange'a mogłaby zostać użyta jako F. Jednak w ogólnym przypadku x * nie dostarcza minimum L {x, X *) (patrz drugi fragment na Rys. 6b). Dlatego nawet mając X *, nie można liczyć na to, że X * można znaleźć przez bezwarunkową minimalizację funkcji Lagrange'a.

Ch. 6. Zadania z nieliniowymi ograniczeniami

Oznacz przez Wix.k) macierz drugich pochodnych w odniesieniu do x L (x, X), tj.

W (x, x) cw-XM, w. i = i

y tt (x *, X *) może mieć zarówno ujemne, jak i zerowe wartości własne, ale z powodu tego, co powiedziano wcześniej, uznajemy dodatnią macierz Hesse (x ") W (x", X *) Z (x) za pozytywnie zdefiniowaną ( przez Z (x) zwyczajowo oznacza się macierz, której kolumny tworzą podstawę przestrzeni wektorów ortogonalnych do rzędów A (x)). W konsekwencji x * będzie minimalnym punktem L (x, X) w stosunku do X na rozmaitości oryugalnej do gradientów więzów aktywnych w x *.

Wskazana właściwość optymalności x * oznacza, że odpowiednią funkcję Fu można uzyskać dodając do Lagrangianu termin, który bez naruszania stacjonarności x *, zmienia właściwości macierzy Hesse w odniesieniu do wektorów z podprzestrzeni rozciągniętej przez kolumny A (x). Najczęściej stosuje się karę kwadratową jako taką zmianę, uzyskując w ten sposób zmodyfikowaną funkcję Lagrange'a formularza

L (x. I, p) F (x) - kc (x) -i {xfc (x). (6,24)

Tutaj p jest dodatnim parametrem kary.

W punkcie X * zanika zarówno kara kwadratowa, jak i jej gradient (ponieważ c składa się z funkcji aktywnych więzów w X). Zatem prv X = K * punkt x * jest nieruchomy (w x) dla (6.24). Macierz hesyjska terminu kary to Ci (x) G, (x) -iA {xy A (x). Gdy x = x * jest niezerowe

wyrażenie będzie tylko drugim terminem A {xUA (x). Jest to macierz półsekwencyjna dodatnia, a wszystkie jej wartości własne odpowiadające wektorom własnym ns mają miejsce A (xY, większe niż zero. Oznacza to, że korekta funkcji Lagrange'a w (6.24) prowadzi do wzrostu (być może ujemnego) wartości własnych macierzy W dla wektorów z przestrzeni rangi A (xV, podczas gdy właściwości macierzy Hesji w odniesieniu do wektorów ortogonalnych do A {xY, są zachowane. Nietrudno udowodnić istnienie skończonej wartości p takiej, że dla dowolnego p> p macierzy Hesji V}. *, X- *, p) będzie pozytywnie zdefiniowany i co odpowiednio, w l * realizuje się silne lokalne minimum Lix, X *, p), jednocześnie, niezależnie od p, dla dowolnej macierzy Z (x *) prostopadłej do wierszy L (x *), równość

Z (x) VLL>, p) Z (x) = Z (x „) W {x; i.) Z (x).

6.4. Metody modyfikowania funkcji Lagrange'a

to znaczy dodatek karny nie wpływa na zaprojektowaną matrycę Hesse.

Zilustrowaliśmy wpływ opisanej modyfikacji funkcji Lagrange'a na prosty przykład.

Przykład 6.4. Rozważ problem jednowymiarowy

znajdź minx

ograniczając x -) - 1 = 0.

Jest poprawny i dlatego optymalnym punktem jest x * = - 1 i>. * = 3. Tak więc

L (x,?. *) = X »-3 (x - 1).

Ta funkcja w x ma lokalne maksimum. Jednocześnie, dla dowolnego p> p (p = 6), zmodyfikowana funkcja Lagrange'a

La (X, X>, p) = x-3 (x + 1) (x-1- 1) ”

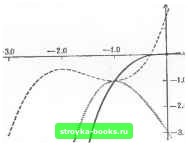

w X * osiąga lokalne minimum. Wykresy dla x i L (x,?. *) Są pokazane na rys. 6 godzin linii stałych i nentirnon. Modifi-

Rys. eh. Linia ciągła jest wykresem funkcji celu z przykładu 6.4, f (x) -x; kropkowany - wykres funkcji Lagrange'a; linia przerywana to wykres spolaryzowanej funkcji Lagrange'a Lix, 9).

Funkcja Lagrange'a z p = 9 jest przerywana. Zauważ, że nie są one ograniczone od dołu dla żadnej wartości parametru kary p.

6.4.2. SCHEMAT I ALGORYTMY Z MODYFIKOWANYMI FUNKCJAMI LAGRANGE

Z tego, co powiedziano w sekcji. 6.4.1 wynika z tego, że w idealnym przypadku X * można znaleźć jedną bezwarunkową minimalizację funkcji gładkiej (6,24). Ten przypadek nie ma jednak praktycznego znaczenia, ponieważ zakłada znajomość wektora X *, a bez rozwiązania x * nie można go obliczyć. W rzeczywistej sytuacji ich szacunki są używane zamiast prawdziwych mnożników Lagrange'a. Główna rola, jaką odgrywają w metodach zmodyfikowanych funkcji Lagrange'a, wyjaśnia, dlaczego metody te często nazywane są mnożnikami MetnoikiMU.

Istnieje kilka sposobów używania funkcji typu (6.24) do wyszukiwania warunkowego minimum. Są one zjednoczone w fakcie, że zawsze powstaje n-wymiarowa podzadania bezwarunkowej minimalizacji funkcji różniczkowalnej, która ma swoje oszacowania parametrów mnożników Lagrange'a i zawiera karę, której celem jest obrócenie x * z bezwarunkowego punktu stacjonarnego do punktu bezwarunkowego.

6.4.2.1. Schemat modelu. W tej sekcji przedstawiono jeden ze sposobów wyszukiwania minimum z ograniczeniami i nierównościami przy użyciu zmodyfikowanej funkcji Lagrange'a. Zakłada ona przypisanie początkowej listy ograniczeń zawartych w początkowym oszacowaniu wektora mnożników Lagrange'a L, początkowego przybliżenia Ho, początkowej wartości parametru kary i dodatniej liczby całkowitej K, która posłuży jako górna granica liczby iteracji. Po ustaleniu tego wszystkiego i dokonaniu przypisania A - * - 0 konieczne jest wykonanie następujących czynności.

Algorytm AL (Model metody zmodyfikowanej funkcji Lagrange'a)

Ali. [Sprawdzanie przestrzegania reguł zatrzymania.] Jeśli x spełnia warunki optymalności lub A> / C, zatrzymaj obliczenia. W pierwszym przypadku Xj jest traktowane jako izo-. moja decyzja; w drugim jest znak niepowodzenia.

AL2. [Zminimalizuj zmodyfikowaną funkcję Lagrange'a.] Używając Xj jako punktu początkowego, zastosuj procedurę rozwiązywania podzadania

(6,25)

sugerując możliwość nieograniczonego Lj od dołu. Najlepszym nz przybliżenia, jakie znalazła, jest przyjęcie jako Xfi + i.

AL3. [Przelicz mnożniki Lagrange'a.] W razie potrzeby zmień skład s. Oblicz nowy wektor oszacowań mnożników Lagrange'a X + j.

znajdź minL (x, xj, p).

AL4. [Zwiększenie, jeśli to konieczne, parametru kary.] Jeśli w punkcie x + istnieją pewne ograniczenia: decyzja jest znacznie mniejsza niż w x, przejdź do następnego kroku i w przeciwnym razie zwiększ p.

AL5. [Tłumaczenie licznika iteracji.] Utwórz stopkę przypisania. i wróć do kroku al1.

6.4.2.2. Właściwości zmodyfikowanej funkcji Lagrange'a. Zakładając użycie dowolnej metody ze zmodyfikowaną funkcją Lagrange 1l, musimy pamiętać o następujących okolicznościach.

- * - 1-1

Miejsce minimum. Jeśli chodzi o funkcje kary, opisane w punkcie 6.2 (w przypadku braku specjalnych właściwości pierwotnego problemu), w punkcie x *, w najlepszym przypadku, realizowana jest tylko lokalna minimalna wartość La. Jednocześnie La nie może być ograniczana poniżej dla żadnej wartości parametru kary p . Dlatego, stosując standardowy algorytm minimalizacji bezwarunkowej do podzadania (6.25), konieczne jest zapewnienie odpowiednich środków ostrożności (jest to wskazane w klauzuli AL2 schematu modelowego). Zwykle, zwiększając p na końcu, możliwe jest uzyskanie tak szerokiego obszaru przyciągania l: *, że nieograniczony 1. staje się niebezpieczny. Nie można jednak podać pełnych gwarancji zbieżności z x *.

Trudności w wyborze opcji kary. Czasami trudno jest wybrać odpowiedni parametr p nawet w takich sytuacjach, gdy nie pojawia się problem nieograniczonej funkcji Lagrange'a z dołu. Faktem jest, że wśród wartości p. które zapewniają istnienie lokalnego bezwarunkowego minimum La w x *, wraz z „zbyt dużym”, są zwykle „zbyt małe”. , Zarówno ci, jak i inni dają źle uwarunkowany La. W przypadku napompowanych psów La staje się nieuzasadniona z tych samych powodów, co łagodne funkcje karne. Powodem słabego obłoku 1; Blairinessa La pod niedocenianym p jest degeneracja jego hessianowej macierzy (jeśli hesyjska macierz zwykłej funkcji Lagrange'a jest nieokreślona) z minimalną dopuszczalną p.

Na rys. 61 pokazuje linie poziomu La (x, p) z trzema wartościami parametru p dla problemu z przykładu 6.2, którego ograniczenie jest traktowane jako równość. Druga funkcja (pO.2) jest dobra. Pierwszy (p = 0,075) i trzeci (p = 100) ilustrują konsekwencje wyboru zbyt małego i zbyt dużego p.

Krytyczna rola oszacowań mnożnika Lagrange'a. Ponieważ xf będzie minimalnym punktem zmodyfikowanej funkcji Lagrange'a tylko wtedy, gdy dla zbieżności metody, która go używa, kiedy

Konieczne jest zapewnienie zbieżności wygenerowanych szacunków czynników z X *.

[ 0 ] [ 1 ] [ 2 ] [ 3 ] [ 4 ] [ 5 ] [ 6 ] [ 7 ] [ 8 ] [ 9 ] [ 10 ] [ 11 ] [ 12 ] [ 13 ] [ 14 ] [ 15 ] [ 16 ] [ 17 ] [ 18 ] [ 19 ] [ 20 ] [ 21 ] [ 22 ] [ 23 ] [ 24 ] [ 25 ] [ 26 ] [ 27 ] [ 28 ] [ 29 ] [ 30 ] [ 31 ] [ 32 ] [ 33 ] [ 34 ] [ 35 ] [ 36 ] [ 37 ] [ 38 ] [ 39 ] [ 40 ] [ 41 ] [ 42 ] [ 43 ] [ 44 ] [ 45 ] [ 46 ] [ 47 ] [ 48 ] [ 49 ] [ 50 ] [ 51 ] [ 52 ] [ 53 ] [ 54 ] [ 55 ] [ 56 ] [ 57 ] [ 58 ] [ 59 ] [ 60 ] [ 61 ] [ 62 ] [ 63 ] [ 64 ] [ 65 ] [ 66 ] [ 67 ] [ 68 ] [ 69 ] [ 70 ] [ 71 ] [ 72 ] [ 73 ] [ 74 ] [ 75 ] [ 76 ] [ 77 ] [ 78 ] [ 79 ] [ 80 ] [ 81 ] [ 82 ] [ 83 ]

0,0014

X,?